مدل های بزرگ زبان (LLM) به سرعت از سیستم های پیش بینی متن ساده به موتورهای استدلال پیشرفته ای که قادر به مقابله با چالش های پیچیده هستند ، در حال تحول هستند. در ابتدا برای پیش بینی کلمه بعدی در یک جمله طراحی شده است ، این مدل ها اکنون به حل معادلات ریاضی ، نوشتن کد عملکردی و تصمیم گیری های محور داده پیش رفته اند. توسعه تکنیک های استدلال محرک اصلی این تحول است که به مدل های هوش مصنوعی اجازه می دهد تا اطلاعات را به روشی ساختار یافته و منطقی پردازش کنند. در این مقاله به بررسی تکنیک های استدلال در پشت مدل هایی مانند Opai’s O3با GROK 3با Deepseek R1با Google’s Gemini 2.0وت کلود 3.7 غزل، برجسته کردن نقاط قوت آنها و مقایسه عملکرد ، هزینه و مقیاس پذیری آنها.

تکنیک های استدلال در مدل های بزرگ زبان

برای دیدن اینکه چگونه این LLM ها به گونه ای متفاوت استدلال می کنند ، ابتدا باید به تکنیک های مختلف استدلال این مدل ها استفاده کنیم. در این بخش ، ما چهار روش اصلی استدلال ارائه می دهیم.

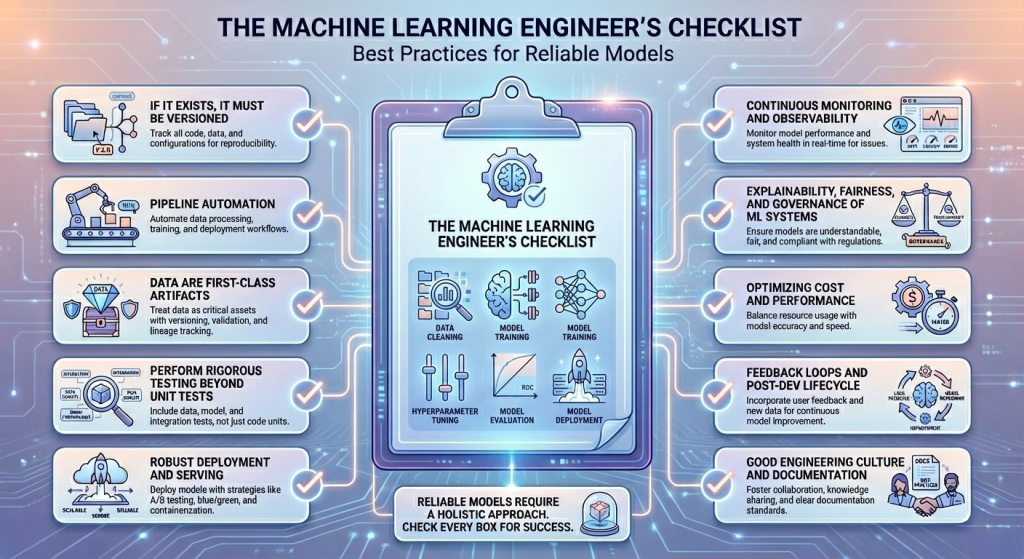

- مقیاس محاسبه زمان استنتاج

این روش استدلال مدل را با اختصاص منابع محاسباتی اضافی در مرحله تولید پاسخ ، بدون تغییر ساختار اصلی مدل یا بازآفرینی آن ، بهبود می بخشد. این اجازه می دهد تا با تولید چندین پاسخ بالقوه ، ارزیابی آنها یا پالایش خروجی آن از طریق مراحل اضافی ، مدل “سخت تر فکر کند”. به عنوان مثال ، هنگام حل یک مشکل ریاضی پیچیده ، مدل ممکن است آن را به قسمت های کوچکتر تجزیه کند و از طریق هر یک از آنها به صورت متوالی کار کند. این رویکرد به ویژه برای کارهایی که نیاز به تفکر عمیق و عمدی دارند ، مانند معماهای منطقی یا چالش های پیچیده برنامه نویسی مفید است. در حالی که دقت پاسخ ها را بهبود می بخشد ، این تکنیک همچنین منجر به هزینه های بیشتر زمان اجرا و زمان پاسخگویی کندتر می شود و این امر را برای برنامه هایی مناسب می کند که دقت از سرعت بیشتری برخوردار باشد. - یادگیری تقویت کننده خالص (RL)

در این تکنیک ، این مدل با پاداش دادن پاسخ های صحیح و مجازات اشتباهات ، از طریق آزمایش و خطا استدلال می کند. این مدل با یک محیط – مانند مجموعه ای از مشکلات یا وظایف – در تعامل است و با تنظیم استراتژی های خود بر اساس بازخورد ، یاد می گیرد. به عنوان مثال ، هنگامی که وظیفه نوشتن کد را بر عهده دارید ، مدل ممکن است راه حل های مختلفی را آزمایش کند و در صورت موفقیت کد ، پاداش کسب می کند. این رویکرد تقلید می کند که چگونه یک شخص از طریق تمرین یک بازی را یاد می گیرد و این مدل را قادر می سازد تا با گذشت زمان با چالش های جدید سازگار شود. با این حال ، RL خالص می تواند از نظر محاسباتی خواستار و گاه ناپایدار باشد ، زیرا این مدل ممکن است میانبرهایی پیدا کند که درک واقعی را منعکس نمی کند. - تنظیم دقیق خالص (SFT)

این روش استدلال را با آموزش مدل فقط بر روی مجموعه داده های دارای کیفیت بالا ، که اغلب توسط انسان یا مدل های قوی تر ایجاد می شود ، تقویت می کند. این مدل یاد می گیرد که الگوهای استدلال صحیح را از این مثالها تکرار کند و آن را کارآمد و پایدار کند. به عنوان مثال ، برای بهبود توانایی خود در حل معادلات ، این مدل ممکن است مجموعه ای از مشکلات حل شده را مطالعه کند ، و یاد می گیرد که همان مراحل را دنبال کند. این رویکرد ساده و مقرون به صرفه است اما به کیفیت داده ها بسیار متکی است. اگر مثالها ضعیف یا محدود باشند ، ممکن است عملکرد مدل رنج ببرد و می تواند با وظایف خارج از محدوده آموزش آن مبارزه کند. SFT خالص برای مشکلات خوب تعریف شده در جایی که نمونه های واضح و قابل اعتماد در دسترس است مناسب است. - یادگیری تقویت با تنظیم دقیق (RL+SFT)

این رویکرد پایداری تنظیم دقیق تحت نظارت را با سازگاری یادگیری تقویت کننده ترکیب می کند. مدل ها ابتدا تحت آموزش های دارای برچسب ، آموزش های تحت نظارت قرار می گیرند ، که یک پایه دانش محکم را ارائه می دهد. پس از آن ، یادگیری تقویت کننده به اصلاح مهارت های حل مسئله مدل کمک می کند. این روش ترکیبی ثبات و سازگاری را متعادل می کند و ضمن کاهش خطر رفتار نامنظم ، راه حل های مؤثر را برای کارهای پیچیده ارائه می دهد. با این حال ، به منابع بیشتری نسبت به تنظیم دقیق نظارتی خالص نیاز دارد.

رویکردهای استدلال در LLM های پیشرو

حال ، بیایید بررسی کنیم که چگونه این تکنیک های استدلال در LLM های پیشرو از جمله Openai’s O3 ، Grok 3 ، Deepseek R1 ، Google’s Gemini 2.0 و Claude 3.7 Sonnet اعمال می شود.

- Opai’s O3

Opai’s O3 در درجه اول از مقیاس محاسبه زمان استنتاج برای افزایش استدلال خود استفاده می کند. با اختصاص منابع محاسباتی اضافی در طول تولید پاسخ ، O3 قادر به ارائه نتایج بسیار دقیق در مورد کارهای پیچیده مانند ریاضیات پیشرفته و برنامه نویسی است. این رویکرد به O3 اجازه می دهد تا فوق العاده خوبی را در معیارهایی مانند آن انجام دهد تست قوس وگیبشر با این حال ، این هزینه به هزینه هزینه های استنباط بالاتر و زمان پاسخگویی کندتر می رسد ، و آن را برای برنامه هایی که دقت آن بسیار مهم است ، مانند تحقیق یا حل مسئله فنی ، مناسب است. - Xai’s Grok 3

Grok 3 ، که توسط XAI ساخته شده است ، مقیاس محاسبه زمان استنتاج را با سخت افزار تخصصی ، مانند فرآیند مشترک برای کارهایی مانند دستکاری ریاضی نمادین ترکیب می کند. این معماری منحصر به فرد به Grok 3 اجازه می دهد تا مقادیر زیادی از داده ها را به سرعت و با دقت پردازش کنند ، و آن را برای برنامه های زمان واقعی مانند تجزیه و تحلیل مالی و پردازش داده های زنده بسیار مؤثر می کند. در حالی که Grok 3 عملکرد سریع را ارائه می دهد ، تقاضای محاسباتی بالای آن می تواند هزینه ها را افزایش دهد. در محیط هایی که سرعت و دقت از آن مهم است ، برتری دارد. - Deepseek R1

Deepseek R1 در ابتدا از یادگیری تقویت کننده خالص برای آموزش مدل خود استفاده می کند و به آن اجازه می دهد تا از طریق آزمایش و خطا ، استراتژی های مستقل حل مسئله را توسعه دهد. این امر باعث می شود Deepseek R1 سازگار و قادر به انجام وظایف ناآشنا ، مانند چالش های پیچیده ریاضی یا برنامه نویسی باشد. با این حال ، RL خالص می تواند منجر به خروجی های غیرقابل پیش بینی شود ، بنابراین Deepseek R1 در مراحل بعدی تنظیم دقیق نظارت شده برای بهبود قوام و انسجام را شامل می شود. این رویکرد ترکیبی Deepseek R1 را به عنوان یک انتخاب مقرون به صرفه برای برنامه هایی که در اولویت انعطاف پذیری نسبت به پاسخ های جلا قرار دارند ، قرار می دهد. - Google’s Gemini 2.0

Google’s Gemini 2.0 از یک رویکرد ترکیبی استفاده می کند که احتمالاً مقیاس بندی محاسبات زمان استنتاج را با یادگیری تقویت کننده ترکیب می کند تا قابلیت های استدلال خود را تقویت کند. این مدل برای رسیدگی به ورودی های چند حالته مانند متن ، تصاویر و صدا در حالی که در کارهای استدلال در زمان واقعی عالی است ، طراحی شده است. توانایی آن در پردازش اطلاعات قبل از پاسخ ، دقت بالایی را به ویژه در نمایش داده های پیچیده تضمین می کند. با این حال ، مانند سایر مدلهای با استفاده از مقیاس زمان استنباط ، Gemini 2.0 می تواند برای کارآیی پرهزینه باشد. این ایده آل برای برنامه هایی است که نیاز به استدلال و درک چند حالته دارند ، مانند دستیاران تعاملی یا ابزارهای تجزیه و تحلیل داده ها. - Claude 3.7 غزل Anthropic

Claude 3.7 غزل از انسان شناسی مقیاس محاسبه زمان استنباط را با تمرکز بر ایمنی و تراز ادغام می کند. این مدل را قادر می سازد در کارهایی که به دقت و توضیح نیاز دارند ، مانند تجزیه و تحلیل مالی یا بررسی اسناد حقوقی ، عملکرد خوبی داشته باشد. حالت “تفکر گسترده” آن به آن اجازه می دهد تا تلاش های استدلال خود را تنظیم کند ، و آن را برای حل مسئله سریع و عمیق همه کاره می کند. در حالی که انعطاف پذیری را ارائه می دهد ، کاربران باید تجارت بین زمان پاسخ و عمق استدلال را مدیریت کنند. Claude 3.7 غزل مخصوصاً برای صنایع تنظیم شده مناسب است که شفافیت و قابلیت اطمینان بسیار مهم است.

خط پایین

تغییر از مدلهای اساسی زبان به سیستم های استدلال پیشرفته نشان دهنده یک جهش بزرگ در فناوری هوش مصنوعی است. با استفاده از تکنیک های اعمال شده مانند مقیاس محاسبه زمان استنتاج ، یادگیری تقویت کننده خالص ، RL+SFT و SFT خالص ، مدل هایی مانند Openai’s O3 ، Grok 3 ، Deepseek R1 ، Google’s Gemini 2.0 و Claude 3.7 غزل در حل مشکلات پیچیده و واقعی در دنیای ماهر تر شده اند. رویکرد هر مدل به استدلال ، نقاط قوت خود را تعریف می کند ، از حل مسئله عمدی O3 تا انعطاف پذیری مقرون به صرفه Deepseek R1. از آنجا که این مدل ها همچنان در حال تحول هستند ، آنها امکانات جدیدی را برای هوش مصنوعی باز می کنند و آن را به ابزاری قدرتمندتر برای پرداختن به چالش های دنیای واقعی تبدیل می کنند.