هنگامی که آندره کارپتی ، بنیانگذار OpenAI ، هفته گذشته اصطلاح “رمزگذاری Vibe” را ابداع کرد ، او یک نقطه تورم را به خود اختصاص داد: توسعه دهندگان به طور فزاینده ای در حال پیشبرد AI تولید کننده برای تهیه کد هستند در حالی که آنها روی راهنمایی های سطح بالا تمرکز می کنند و “به سختی حتی صفحه کلید را لمس می کنند.”

سیستم عامل های بنیادی LLM-Github Copilot ، Deepseek ، OpenAI-در حال توسعه نرم افزار هستند و مکان نما اخیراً به سریعترین شرکت تبدیل می شود همیشه برای دریافت 1 میلیون دلار درآمد مکرر سالانه به 100 میلیون دلار (در کمتر از یک سال). اما این سرعت با هزینه ای حاصل می شود.

بدهی فنی ، که قبلاً برای مشاغل هزینه تخمین زده شده است به بالا 1.5 تریلیون دلار سالانه در ناکارآمدی های عملیاتی و امنیتی ، چیز جدیدی نیست. اما اکنون شرکت ها با ظهور روبرو هستند و من معتقدم حتی بیشتر ، چالش: بدهی فنی هوش مصنوعی-یک بحران ساکت که توسط کد ناکارآمد ، نادرست و بالقوه ناامن ناشی می شود.

تنگنای انسانی از کد نویسی به بررسی پایگاه کد منتقل شده است

بررسی 2024 GitHub دریافت که تقریباً همه توسعه دهندگان سازمانی (97 ٪) از ابزارهای برنامه نویسی AI تولیدی استفاده می کنند ، اما تنها 38 ٪ از توسعه دهندگان آمریکایی گفتند که سازمان آنها به طور فعال استفاده از ژنرال AI را تشویق می کند.

توسعه دهندگان عاشق استفاده از مدل های LLM برای تولید کد برای ارسال بیشتر ، سریعتر و شرکت برای تسریع در نوآوری هستند. با این حال-بررسی های دستی و ابزارهای میراث نمی توانند برای بهینه سازی و اعتبارسنجی میلیون ها خط کد تولید شده توسط AI روزانه سازگار یا مقیاس شوند.

با استفاده از این نیروهای بازار ، حاکمیت و نظارت سنتی می تواند شکسته شود و هنگامی که شکسته شود ، کد کم اعتبار به داخل پشته شرکت می رود.

ظهور توسعه دهندگان “برنامه نویسی VIBE” خطر بالا بردن حجم و هزینه بدهی فنی را به خطر می اندازد ، مگر اینکه سازمان ها نگهبانانی را اجرا کنند که سرعت نوآوری را با اعتبار فنی تعادل برقرار می کنند.

توهم سرعت: هنگامی که AI از حاکمیت خارج می شود

کد تولید شده AI ذاتاً ناقص نیست-فقط بی ارزش با سرعت و مقیاس کافی.

داده ها را در نظر بگیرید: همه LLM ها از دست دادن مدل (توهم) نشان می دهند. یک مقاله تحقیقاتی اخیر در مورد کیفیت تولید کد Copilot Github میزان خطای 20 ٪ یافتبشر ترکیب این مسئله حجم کاملی از خروجی AI است. یک توسعه دهنده واحد می تواند از LLM برای تولید 10،000 خط کد در عرض چند دقیقه استفاده کند و از توانایی توسعه دهندگان انسانی برای بهینه سازی و اعتبار آن پیشی بگیرد. آنالایزرهای استاتیک میراث ، که برای منطق نوشته شده انسان طراحی شده اند ، با الگوهای احتمالی خروجی های AI مبارزه می کنند. نتیجه؟ صورتحساب های ابر نفهمیده شده از الگوریتم های ناکارآمد ، خطرات مربوط به انطباق از وابستگی های غیرمجاز و خرابی های مهم در محیط های تولیدی.

جوامع ، شرکت ها و زیرساخت های بحرانی ما همه به نرم افزار مقیاس پذیر ، پایدار و ایمن بستگی دارند. پرداخت بدهی فنی AI محور به شرکت می تواند به معنای ریسک مهم تجارت باشد … یا بدتر.

بازپس گیری کنترل بدون کشتن vibe

راه حل این نیست که هوش مصنوعی تولیدی را برای برنامه نویسی رها کنیم-این برای توسعه دهندگان است که همچنین می توانند سیستم های AI عامل را به عنوان بهینه سازهای و اعتبار سنجی کد های گسترده و با مقیاس گسترده مستقر کنند. یک مدل عامل می تواند از تکنیک هایی مانند الگوریتم های تکاملی برای تکرار کد در چندین LLM برای بهینه سازی آن برای بهینه سازی معیارهای کلیدی – مانند کارآیی ، سرعت زمان اجرا ، استفاده از حافظه استفاده کند و عملکرد و قابلیت اطمینان آن را در شرایط مختلف تأیید کند.

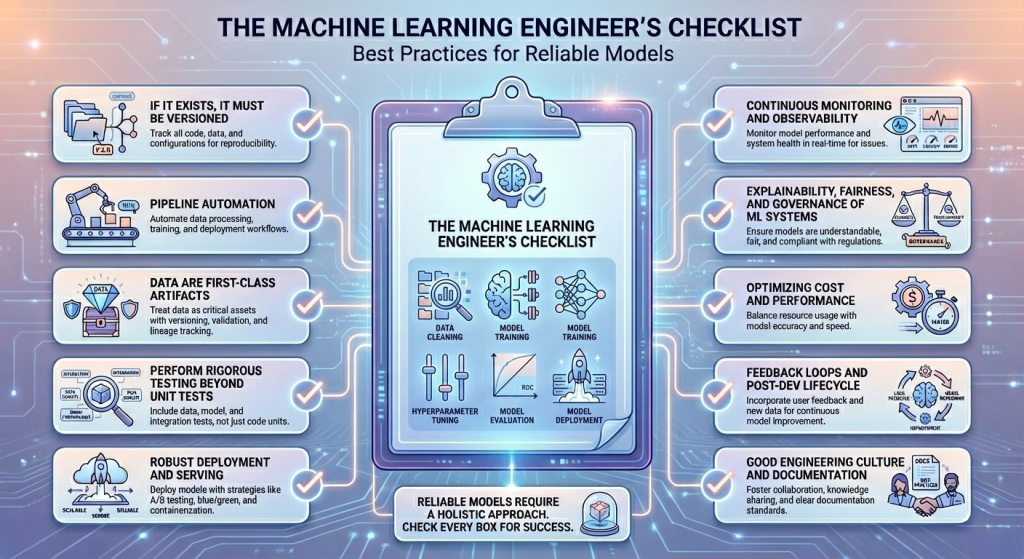

سه اصل بنگاه هایی را که با هوش مصنوعی از کسانی که در بدهی فنی محور AI غرق می شوند ، جدا می کنند:

- اعتبار سنجی مقیاس پذیر غیر قابل مذاکره است: شرکت ها باید سیستم های AI عامل را قادر به اعتبار و بهینه سازی کد تولید شده AI در مقیاس اتخاذ کنند. بررسی های دستی و ابزارهای میراث سنتی برای رسیدگی به حجم و پیچیدگی کد تولید شده توسط LLMS کافی نیست. بدون اعتبار سنجی مقیاس پذیر ، ناکارآمدی ، آسیب پذیری های امنیتی و خطرات مربوط به انطباق باعث افزایش ارزش تجارت می شود.

- سرعت تعادل با حاکمیت: در حالی که هوش مصنوعی تولید کد را تسریع می کند ، چارچوب های حاکمیتی برای حفظ سرعت باید تکامل یابد. سازمانها باید نگهبانان را اجرا کنند که اطمینان حاصل کنند که کد تولید شده توسط AI از استانداردهای کیفیت ، امنیت و عملکرد برخوردار است بدون اینکه نوآوری را خفه کند. این تعادل برای جلوگیری از توهم سرعت به یک واقعیت گران قیمت بدهی فنی بسیار مهم است.

- فقط هوش مصنوعی می تواند با هوش مصنوعی همراه باشد: حجم کامل و پیچیدگی کد تولید شده توسط AI به همان اندازه راه حل های پیشرفته. شرکت ها باید سیستم های محور AI را اتخاذ کنند که می توانند به طور مداوم کد را در مقیاس تجزیه و تحلیل ، بهینه سازی و اعتبارسنجی کنند. این سیستم ها اطمینان حاصل می کنند که سرعت توسعه با هوش مصنوعی کیفیت ، امنیت یا عملکرد را به خطر نمی اندازد و باعث می شود نوآوری پایدار بدون ایجاد بدهی فنی فلج شود.

برنامه نویسی VIBE: بیایید دور نشویم

شرکت هایی که اقدامات خود را در “برنامه نویسی VIBE” به تعویق انداختند ، در بعضی مواقع باید با موسیقی روبرو شوند: فرسایش حاشیه ای از هزینه های ابر فراری ، فلج نوآوری در حالی که تیم ها برای اشکال زدایی کد شکننده ، نصب بدهی فنی و خطرات پنهان از نقص های امنیتی ناشی از AI تلاش می کنند.

مسیر پیش رو برای توسعه دهندگان و شرکت ها به طور یکسان نیاز به تصدیق آن دارد فقط هوش مصنوعی می تواند AI را بهینه و اعتبار دهد در مقیاس آنها با دسترسی به توسعه دهندگان به ابزارهای اعتبار سنجی عامل ، آنها می توانند بدون تسلیم شرکت در نصب بدهی فنی تولید شده AI ، “برنامه نویسی پرشور” را در آغوش بگیرند. همانطور که Karpathy خاطرنشان می کند ، پتانسیل کد تولید شده AI هیجان انگیز است-حتی مسموم کننده. اما در توسعه شرکت ، ابتدا باید توسط یک نژاد تکاملی جدید عامل AI ، یک بررسی پرشور انجام شود.