مردم در ژاپن با همان احترام به همان میزان احترام ، با همان احترام رفتار می کنند ، در حالی که آمریکایی ها طبق یک مطالعه جدید به طور قابل توجهی بیشتر می توانند از هوش مصنوعی استفاده کنند. منتشر شده در گزارش های علمی توسط محققان LMU مونیخ و دانشگاه Waseda توکیو.

به عنوان وسایل نقلیه خود رانندگی و سایرین روبات های خودمختار به طور فزاینده ای در زندگی روزمره ادغام می شود ، نگرش های فرهنگی نسبت به عوامل مصنوعی ممکن است تعیین کند که این فناوری ها در جوامع مختلف چقدر سریع و با موفقیت اجرا می شوند.

شکاف فرهنگی در همکاری بشر و او

دکتر یورگیس کارپوس ، محقق رهبری LMU مونیخ ، در این مطالعه گفت: “هرچه فناوری خود رانندگی به واقعیت تبدیل شود ، این برخوردهای روزمره نحوه اشتراک ما را با ماشین های هوشمند تعریف می کند.”

این تحقیق یکی از اولین معاینات جامع بین فرهنگی را در مورد چگونگی تعامل انسان با عوامل مصنوعی در سناریوهایی که ممکن است منافع همیشه هماهنگ نباشد ، نشان می دهد. این یافته ها این فرض را به چالش می کشد که بهره برداری از الگوریتم – تمایل به استفاده از هوش مصنوعی تعاونی – یک پدیده جهانی است.

نتایج حاکی از آن است که هرچه فن آوری های خودمختار شیوع بیشتری پیدا می کنند ، جوامع ممکن است چالش های مختلف ادغام را بر اساس نگرش فرهنگی نسبت به هوش مصنوعی تجربه کنند.

روش تحقیق: تئوری بازی تفاوتهای رفتاری را نشان می دهد

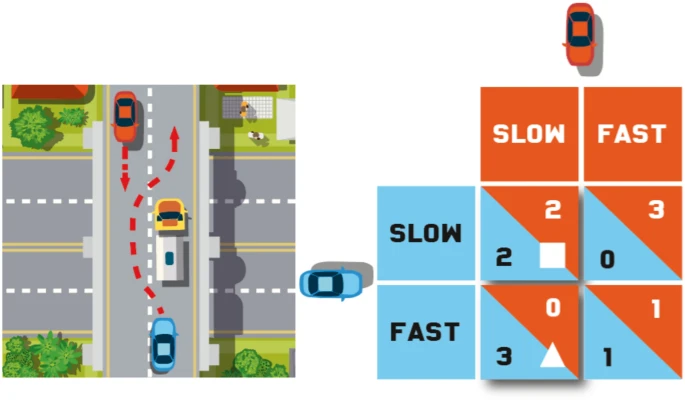

تیم تحقیق از آزمایشات کلاسیک اقتصاد رفتاری استفاده کرده است – بازی اعتماد و معضل زندانی– برای مقایسه نحوه شرکت کنندگان در ژاپن و ایالات متحده با هم شرکای انسانی و هم در سیستم های هوش مصنوعی در تعامل بودند.

در این بازی ها ، شرکت کنندگان بین منافع شخصی و متقابل ، با مشوق های پولی واقعی برای اطمینان از تصمیم گیری واقعی به جای موارد فرضی ، انتخاب کردند. این طرح آزمایشی به محققان این امکان را می دهد تا به طور مستقیم نحوه برخورد شرکت کنندگان با انسان در مقابل هوش مصنوعی را در سناریوهای یکسان مقایسه کنند.

این بازی ها با دقت ساختار یافته بودند تا شرایط روزمره ، از جمله سناریوهای ترافیکی را تکرار کنند ، جایی که انسان باید تصمیم بگیرد که آیا با یک عامل دیگر همکاری یا بهره برداری کند. شرکت کنندگان در دورهای مختلف ، گاهی اوقات با شرکای انسانی و گاهی اوقات با سیستم های هوش مصنوعی بازی می کردند و امکان مقایسه مستقیم رفتارهای خود را فراهم می کردند.

این مقاله می گوید: “شرکت کنندگان ما در ایالات متحده با عوامل مصنوعی به طور قابل توجهی کمتر از آنچه که با انسان انجام داده بودند همکاری کردند ، در حالی که شرکت کنندگان در ژاپن سطح معادل همکاری با هر دو نوع همکار را به نمایش گذاشتند.”

Karpus ، J. ، Shirai ، R. ، Verba ، Jt et al.

گناه به عنوان یک عامل اصلی در تفاوت های فرهنگی

محققان پیشنهاد می کنند که تفاوت در گناه با تجربه ، محرک اصلی تنوع فرهنگی مشاهده شده در نحوه برخورد افراد با عوامل مصنوعی است.

این مطالعه نشان داد که مردم در غرب ، به طور خاص در ایالات متحده ، هنگام سوءاستفاده از یک انسان دیگر ، اما نه هنگام بهره برداری از یک دستگاه ، احساس پشیمانی می کنند. در مقابل ، در ژاپن ، مردم به نظر می رسد که آیا آنها با یک شخص یا یک عامل مصنوعی بدرفتاری می کنند.

دکتر کارپوس توضیح می دهد که در تفکر غربی ، قطع یک ربات در ترافیک به احساسات خود آسیب نمی رساند و چشم انداز چشم انداز را برجسته می کند که ممکن است به تمایل بیشتر به بهره برداری از ماشین ها کمک کند.

این مطالعه شامل یک مؤلفه اکتشافی است که شرکت کنندگان پس از فاش شدن نتایج بازی ، پاسخ عاطفی خود را گزارش کردند. این داده ها بینش های اساسی در مورد مکانیسم های روانشناختی اساسی تفاوت های رفتاری ارائه می دهد.

پاسخ های عاطفی الگوهای فرهنگی عمیق تر را نشان می دهد

هنگامی که شرکت کنندگان از هوش مصنوعی تعاونی سوءاستفاده کردند ، شرکت کنندگان ژاپنی گزارش دادند که احساسات منفی بیشتری (گناه ، عصبانیت ، ناامیدی) و احساسات مثبت کمتری (خوشبختی ، پیروزمندانه ، امداد) در مقایسه با همتایان آمریکایی خود دارند.

این تحقیقات نشان داد که مدافعانی که از همکار AI خود در ژاپن سوءاستفاده می کنند ، احساس کردند که نسبت به خط دفاعی در ایالات متحده احساس گناه بیشتری دارند. این پاسخ عاطفی قوی تر ممکن است عدم تمایل بیشتر شرکت کنندگان ژاپنی به بهره برداری از عوامل مصنوعی را توضیح دهد.

برعکس ، آمریکایی ها هنگام بهره برداری از انسان نسبت به هوش مصنوعی ، احساسات منفی بیشتری را احساس می کردند ، تمایزی که بین شرکت کنندگان ژاپنی مشاهده نمی شود. برای مردم ژاپن ، پاسخ عاطفی بدون در نظر گرفتن اینکه از یک انسان یا یک عامل مصنوعی سوء استفاده کرده اند ، مشابه بود.

این مطالعه خاطرنشان می کند که شرکت کنندگان ژاپنی به طور مشابه در مورد سوء استفاده از همکاران انسانی و هوش مصنوعی در تمام احساسات مورد بررسی احساس می کنند ، و نشان می دهد درک اخلاقی اساساً متفاوت از عوامل مصنوعی در مقایسه با نگرش های غربی است.

انیمیشن و درک روبات ها

پیشینه فرهنگی و تاریخی ژاپن ممکن است نقش مهمی در این یافته ها داشته باشد ، توضیحات بالقوه ای را برای تفاوت های مشاهده شده در رفتار با عوامل مصنوعی و هوش مصنوعی تجسم یافتهبشر

در این مقاله آمده است که وابستگی تاریخی ژاپن به انیمیشن و این عقیده که اشیاء غیر زنده می توانند در بودیسم روح داشته باشند ، این فرض را به وجود آورده است که مردم ژاپن بیشتر از افراد در فرهنگ های دیگر پذیرفته و مراقبت از روبات ها هستند.

این زمینه فرهنگی می تواند یک نقطه شروع اساساً متفاوت برای چگونگی درک عوامل مصنوعی ایجاد کند. در ژاپن ، ممکن است تمایز شدید بین انسان و موجودات غیر انسانی قادر به تعامل باشد.

این تحقیق نشان می دهد که مردم ژاپن بیشتر از مردم ایالات متحده هستند که معتقدند روبات ها می توانند احساسات را تجربه کنند و مایل به پذیرش روبات ها به عنوان اهداف قضاوت اخلاقی بشر هستند.

مطالعات ذکر شده در این مقاله حاکی از تمایل بیشتر در ژاپن برای درک عوامل مصنوعی مانند انسان است ، با روبات ها و انسان ها که اغلب به عنوان شرکا به جای روابط سلسله مراتبی به تصویر می کشند. این دیدگاه می تواند توضیح دهد که چرا شرکت کنندگان ژاپنی از نظر عاطفی با عوامل مصنوعی و انسانها با توجه مشابه رفتار می کردند.

پیامدهای مربوط به اتخاذ فناوری خودمختار

این نگرشهای فرهنگی می تواند به طور مستقیم تأثیر بگذارد که فناوری های خودمختار در مناطق مختلف با پیامدهای اقتصادی و اجتماعی به طور بالقوه بسیار دور از کشور اتخاذ می شوند.

دکتر کارپوس حدس می زند که اگر مردم ژاپن با همان احترام به انسان ، روبات ها را درمان کنند ، ممکن است تاکسی های کاملاً خودمختار در توکیو سریعتر از شهرهای غربی مانند برلین ، لندن یا نیویورک عادی شوند.

اشتیاق به بهره برداری از وسایل نقلیه خودمختار در برخی فرهنگ ها می تواند چالش های عملی را برای ادغام صاف آنها در جامعه ایجاد کند. اگر رانندگان به احتمال زیاد اتومبیل های خودران را قطع کنند ، حق خود را در دست بگیرند ، یا در غیر این صورت از احتیاط برنامه ریزی شده خود سوءاستفاده کنند ، می تواند مانع از کارآیی و ایمنی این سیستم ها شود.

محققان پیشنهاد می کنند که این اختلافات فرهنگی می تواند به طور قابل توجهی در جدول زمانی برای اتخاذ گسترده فن آوری ها مانند هواپیماهای بدون سرنشین تحویل ، حمل و نقل عمومی خودمختار و وسایل نقلیه شخصی خود رانندگی تأثیر بگذارد.

جالب اینجاست که این مطالعه تفاوت چندانی در نحوه همکاری شرکت کنندگان ژاپنی و آمریکایی با سایر انسانها و هماهنگی با تحقیقات قبلی در اقتصاد رفتاری نشان داد.

در این مطالعه تفاوت محدودی در تمایل شرکت کنندگان ژاپنی و آمریکایی برای همکاری با سایر انسانها مشاهده شده است. این یافته برجسته می کند که واگرایی به طور خاص در زمینه تعامل انسان و آه به جای بازتاب تفاوت های فرهنگی گسترده تر در رفتار تعاونی بوجود می آید.

این قوام در همکاری های انسانی و انسانی یک مبنای مهم را برای اندازه گیری تفاوت های فرهنگی در تعامل انسان و AI ، فراهم می کند ، و نتیجه گیری های مطالعه را در مورد منحصر به فرد بودن الگوی مشاهده شده تقویت می کند.

پیامدهای گسترده تر برای توسعه هوش مصنوعی

این یافته ها پیامدهای قابل توجهی برای توسعه و استقرار سیستم های هوش مصنوعی برای تعامل با انسان در زمینه های مختلف فرهنگی دارد.

این تحقیق بر لزوم در نظر گرفتن عوامل فرهنگی در طراحی و اجرای سیستم های هوش مصنوعی که با انسان تعامل دارند ، تأکید می کند. نحوه درک و تعامل مردم با هوش مصنوعی جهانی نیست و می تواند به طور قابل توجهی در فرهنگ ها متفاوت باشد.

نادیده گرفتن این ظرافت های فرهنگی می تواند منجر به عواقب ناخواسته ، نرخ اتخاذ کندتر و پتانسیل سوء استفاده یا بهره برداری از فناوری های هوش مصنوعی در مناطق خاص شود. این اهمیت مطالعات متقابل فرهنگی را در درک تعامل انسان و آه و اطمینان از توسعه و استقرار مسئولیت پذیر AI در سطح جهان برجسته می کند.

محققان پیشنهاد می کنند که با ادغام هوش مصنوعی در زندگی روزمره ، درک این اختلافات فرهنگی برای اجرای موفقیت آمیز فن آوری هایی که نیاز به همکاری بین انسان و عوامل مصنوعی دارند ، به طور فزاینده ای اهمیت می یابد.

محدودیت ها و جهت های تحقیق آینده

محققان محدودیت های خاصی را در کار خود تأیید می کنند که به جهت های تحقیقات آینده اشاره دارد.

این مطالعه در درجه اول فقط به دو کشور-ژاپن و ایالات متحده-متمرکز شده است که ضمن ارائه بینش های ارزشمند ، ممکن است طیف کاملی از تنوع فرهنگی در تعامل انسان و عایدی را در سطح جهان ضبط نکند. تحقیقات بیشتر در طیف گسترده ای از فرهنگ ها برای تعمیم این یافته ها لازم است.

علاوه بر این ، در حالی که آزمایش های تئوری بازی سناریوهای کنترل شده ای را برای تحقیقات تطبیقی فراهم می کنند ، ممکن است پیچیدگی های تعاملات انسانی و انسانی در دنیای واقعی را به طور کامل ضبط نکنند. محققان پیشنهاد می کنند که اعتبارسنجی این یافته ها در مطالعات میدانی با فن آوری های خودمختار واقعی یک مرحله بعدی مهم خواهد بود.

توضیحات مبتنی بر گناه و اعتقادات فرهنگی در مورد روبات ها ، در حالی که توسط داده ها پشتیبانی می شود ، نیاز به تحقیقات تجربی بیشتر برای ایجاد قطعی علیت دارد. محققان خواستار مطالعات هدفمندتری هستند که به بررسی مکانیسم های روانشناختی خاص اساسی این تفاوت های فرهنگی می پردازند.

محققان نتیجه می گیرند: “یافته های فعلی ما تعمیم این نتایج را نشان می دهد و نشان می دهد که سوء استفاده از الگوریتم یک پدیده متقابل فرهنگی نیست.”